La inteligencia artificial, por fin, bajo regulación en la Unión Europea. El pasado 12 de julio de 2024 se publicó el primer Reglamento europeo en materia de inteligencia artificial (IA).

La Ley de IA es la primera norma de la UE que aborda los riesgos de la inteligencia artificial, siendo uno de sus objetivos más ambiciosos el que la UE desempeñe un papel de liderazgo a nivel mundial, ya que es el primer marco jurídico integral sobre IA.

El objetivo de la Ley de IA europea es fomentar una IA fiable en Europa, estableciendo un conjunto de normas basadas en el riesgo para los desarrolladores e implementadores de IA en relación con usos específicos de la IA.

Junto a esta Ley, la UE incluye un paquete de medidas políticas para lograr una IA más fiable, entre ellas, el paquete de Innovación en IA, el lanzamiento de las fábricas de IA y el Plan coordinado sobre Inteligencia Artificial.

Lo que pretende Europa con este paquete de medidas es, a su juicio: “garantizar la seguridad, los derechos fundamentales y la IA centrada en el ser humano, y fortalecer la adopción, la inversión y la innovación en IA en toda la UE”.

A fin de facilitar el cambio hacia el nuevo marco normativo, la Comisión ha lanzado el llamado Pacto de IA, que busca involucrar a las empresas y demás partes interesadas, incluidos los proveedores de IA.

¿Es necesario reglamentar la inteligencia artificial?

La Ley de IA persigue que los europeos puedan confiar en la IA.

Uno de los ejemplos más claros en los que la IA puede generar desconfianza es que ciertos sistemas de IA generan riesgos con resultados indeseables, por ejemplo, en muchas ocasiones no es posible averiguar por qué un sistema de IA ha tomado una decisión o una predicción y ha llevado a cabo una acción determinada, por lo que puede resultar difícil evaluar si alguien ha sido perjudicado injustamente, como en una decisión de contratación o en una solicitud de un plan de prestaciones públicas.

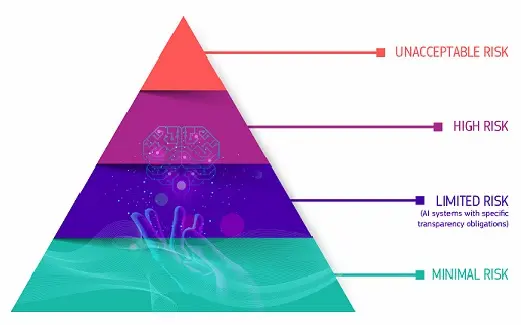

Niveles de riesgo de la inteligencia artificial

Y aunque la legislación vigente ofrece cierta protección, es insuficiente para abordar los desafíos específicos que plantean los sistemas de IA.

La Ley de IA define cuatro niveles de riesgo para los sistemas de IA:

1.- Riesgo inaceptable

Se prohíben todos los sistemas de IA que se consideren una clara amenaza para la seguridad, los medios de vida y los derechos de las personas.

La Ley de IA prohíbe ocho prácticas:

- Manipulación y engaño dañinos basados en IA

- Explotación dañina de vulnerabilidades basada en IA

- Puntuación social

- Evaluación o predicción del riesgo de delito individual

- Extracción no dirigida de material de Internet o de CCTV para crear o ampliar bases de datos de reconocimiento facial

- Reconocimiento de emociones en lugares de trabajo e instituciones educativas

- Categorización biométrica para deducir ciertas características protegidas

- Identificación biométrica remota en tiempo real para fines de aplicación de la ley en espacios de acceso público

2.- Alto riesgo

Son los supuestos de uso de IA que pueden suponer graves riesgos para la salud, la seguridad o los derechos fundamentales. Entre otros:

- Componentes de seguridad de IA en infraestructuras críticas (por ejemplo, transporte), cuyo fallo podría poner en riesgo la vida y la salud de los ciudadanos

- Soluciones de IA utilizadas en instituciones educativas que pueden determinar el acceso a la educación y el curso de la vida profesional de alguien (por ejemplo, la calificación de los exámenes)

- Componentes de seguridad de productos basados en IA (por ejemplo, aplicación de IA en cirugía asistida por robot)

- Herramientas de inteligencia artificial para el empleo, la gestión de trabajadores y el acceso al autoempleo (por ejemplo, software de clasificación de CV para la contratación)

- Uso de la IA para acceder a servicios públicos y privados esenciales (por ejemplo, la calificación crediticia niega a los ciudadanos la oportunidad de obtener un préstamo)

- Sistemas de IA utilizados para la identificación biométrica remota, el reconocimiento de emociones y la categorización biométrica (por ejemplo, uso de la IA para identificar retroactivamente al autor de un robo en establecimiento)

- Uso de IA en la gestión de la migración, el asilo y el control de fronteras (por ejemplo, el examen automatizado de solicitudes de visado)

- Sistemas de IA en la administración de justicia y en los procesos democráticos (por ejemplo, soluciones de IA para preparar sentencias judiciales)

Los sistemas de IA de alto riesgo estarán sujetos a estrictas obligaciones antes de poder comercializarse, como utilizar sistemas adecuados de evaluación y mitigación de riesgos; Alta calidad de los conjuntos de datos que alimentan el sistema para minimizar los riesgos de resultados discriminatorios; Registro de actividad para garantizar la trazabilidad de los resultados; documentación detallada que proporcione toda la información necesaria sobre el sistema y su finalidad para que las autoridades evalúen su cumplimiento; Información clara y adecuada al implementador; Medidas adecuadas de supervisión humana y Alto nivel de robustez, ciberseguridad y precisión.

3.- Riesgo de transparencia

Este nivel abarca los riesgos asociados con la necesidad de transparencia en torno al uso de la IA.

Por ejemplo, en el caso de utilizar un sistema de IA como los chatbots (programas informáticos que simulan y procesan una conversación humana), los seres humanos deben ser conscientes de que están interactuando con una máquina para que puedan tomar una decisión informada.

Los proveedores de IA están obligados a garantizar la transparencia.

La Ley de IA obliga a que determinados contenidos generados por IA estén etiquetados de forma clara y visible, por ejemplo, los deepfakes (vídeos manipulados para hacer creer a los usuarios que ven a una determinada persona, tanto si es anónima como si es personaje público, realizando declaraciones o acciones que nunca ocurrieron).

4.- Riesgo mínimo o nulo

La Ley de IA no introduce normas para la IA que se considere de riesgo mínimo o nulo. Aquí se encuadran las aplicaciones como los videojuegos basados en IA o los filtros de spam.

Según la Comisión de la UE, la gran mayoría de los sistemas de IA que se utilizan actualmente en la UE entran en esta categoría, lo que sin duda es un alivio, aunque los ciudadanos tendremos que estar muy atentos a los importantes cambios que se avecinan con la llegada definitiva en nuestras vidas de la IA.

¿Cuándo entra en vigor la Ley europea de IA?

La Ley de IA entró en vigor el 1 de agosto de 2024 y será plenamente aplicable dos años después, es decir, el 2 de agosto de 2026, con algunas excepciones:

- Las prohibiciones y obligaciones de alfabetización en IA entraron en vigor el 2 de febrero de 2025.

- Las normas de actuación y las obligaciones para los modelos de IA de propósito general serán aplicables el 2 de agosto de 2025.

- Las normas para los sistemas de IA de alto riesgo (integrados en productos regulados) tienen un período de transición ampliado hasta el 2 de agosto de 2027.

Recuerda que si necesitas otorgar un poder a tu abogado o procurador, puedes hacerlo online y sin necesidad de certificado digital, con las mismas garantías legales que desde la sede electrónica, con ApudActa.com.